项目概览

围绕 Tensor Parallel、Pipeline Parallel 与 Sequence Parallel,拆解模型切分、通信调度与 bubble 形成机制。

背景与动机

当模型规模超过单卡容量后,训练性能不再只取决于算子速度,而取决于通信、显存与调度之间的整体平衡。

核心特性

提供并行策略对照、通信路径图、典型配置建议与故障排查清单,便于后续工程复盘。

核心特性

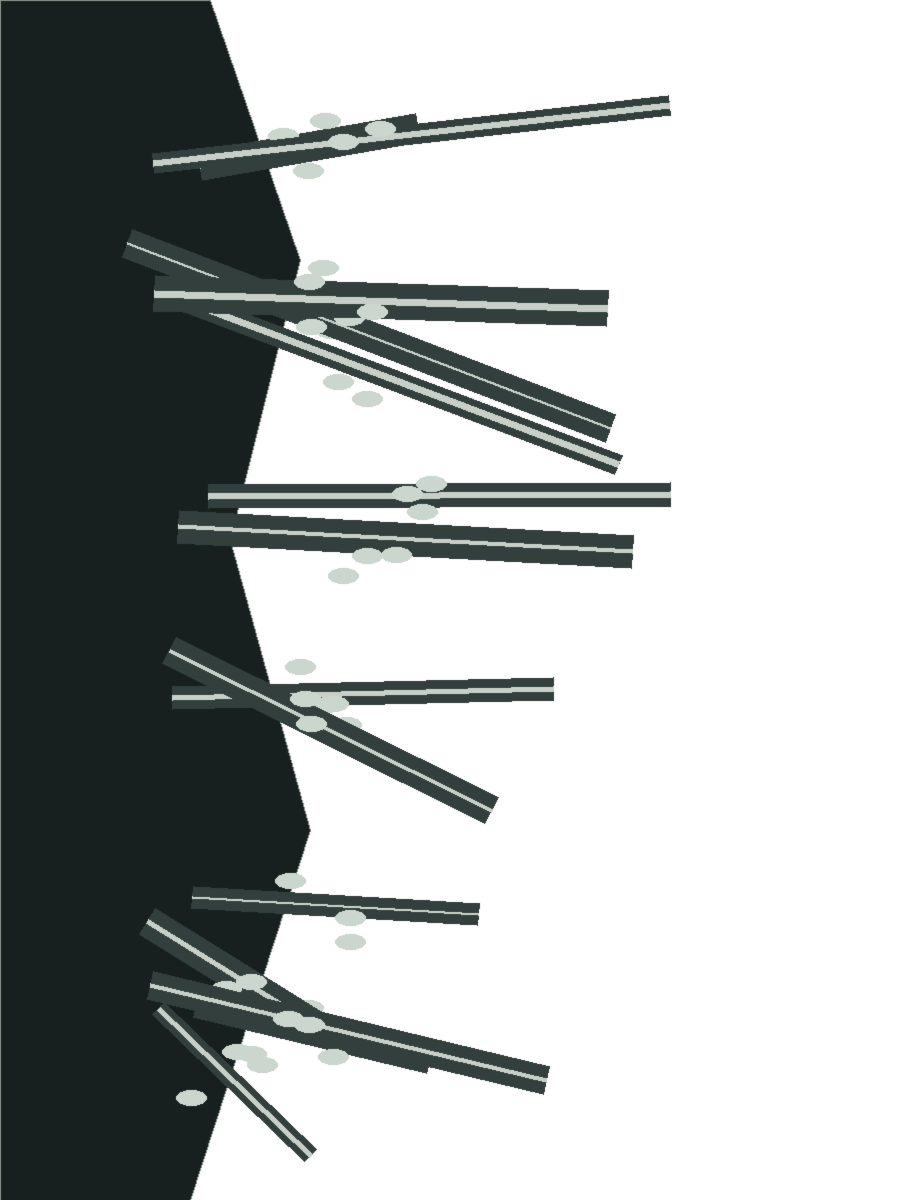

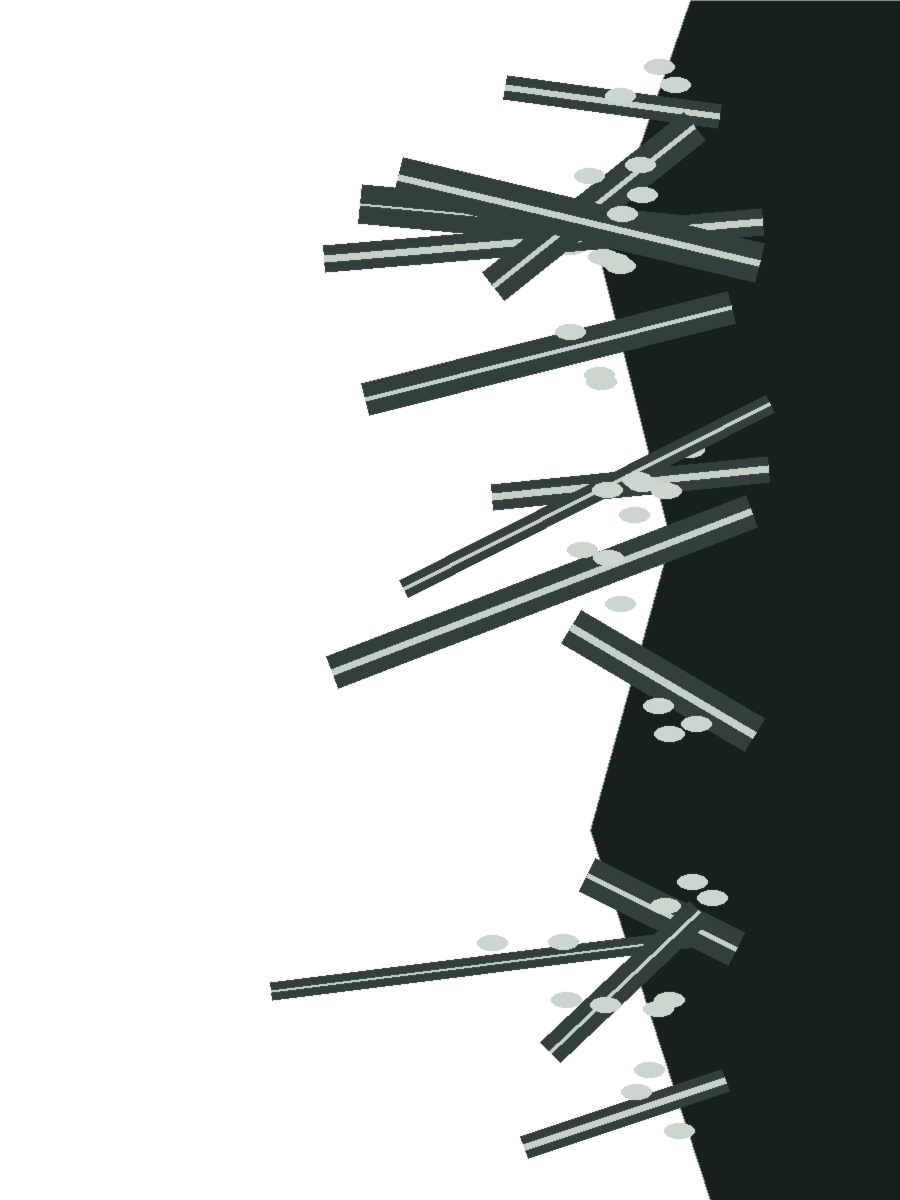

并行地图

TP / PP / SP 边界一图对齐。

通信复盘

记录 Collective 与 overlap 代价。

工程可用

配置、指标、排查路径可复用。

性能示例

| 指标 | 结果 | 说明 |

|---|---|---|

| 训练卡数 | 128 | H100 集群 |

| 并行策略 | 3 | TP / PP / SP |

| 复盘条目 | 42 | 工程笔记 |